화재현장 등 재난시 비정형 환경탐사 가능

국내 연구진이 앞이 보이지 않아도 문제없이 걸어갈 수 있는 사족보행 로봇을 개발했다.

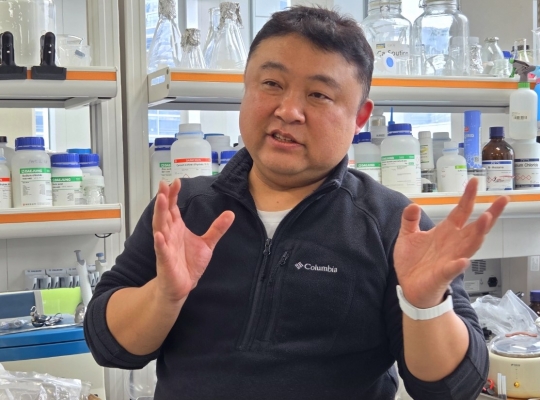

한국과학기술원(KAIST) 전기및전자공학부 명현 교수연구팀은 주변 지형을 직접 보지 않고도 센서로 감지된 정보만 활용해 움직일 수 있는 보행 로봇제어 기술 '드림워크'(DreamWaQ)를 개발했다고 29일 밝혔다. 이 기술이 적용된 로봇 '드림워커'(DreamWaQer)도 만들었다.

연구팀은 "드림워커는 사람이 자다가 깨어나 깜깜한 상황에서도 화장실을 갈 수 있는 것처럼 시각적인 도움이 거의없이 보행이 가능하다"고 설명했다.

기존 보행로봇 제어기는 기구학 또는 동역학 모델을 기본으로 했다. 이러한 모델들은 야지와 같은 불안정한 환경에서 안정적인 보행을 하기 위해 주변 환경 정보를 더욱 빠르게 얻을 수 있어야 한다. 그러나 이는 주변 환경의 인지 능력에 많이 의존하는 모습을 보여 어둡거나 연기가 자욱한 상황에선 활용이 어렵다는 한계가 있다.

반면 명현 교수연구팀이 개발한 인공지능(AI) 심층 강화학습 기반의 제어기는 시뮬레이터를 통해 얻은 다양한 환경 데이터를 기반으로 환경 정보를 직접 얻지 않아도 보행 로봇의 각 모터에 적절한 제어 명령을 빠르게 계산해 줄 수 있다. 게다가 기존에는 시뮬레이션으로 학습한 제어기를 잘 작동시키기 위해 별도의 튜닝 과정이 필요했지만 이번에 개발된 제어기는 별도의 튜닝을 요구하지 않는다.

'드림워크'는 크게 지면과 로봇의 정보를 추정하는 '상황 추정 네트워크'와 제어 명령을 산출하는 '정책 네트워크'로 구성된다. 상황 추정 네트워크는 관성 정보와 관절 움직임을 알려주는 센서를 통해 지면의 정보와 로봇의 현 상태를 추정한다. 추정을 통해 얻어낸 정보는 정책 네트워크에 입력돼 최적의 제어 명령이 산출된다.

정책 네트워크는 시뮬레이션 안에서 심층 강화학습 방법 중 하나인 '행동자-비평자' 방식으로 학습된다. 행동자 네트워크는 환경을 볼 수 없고 추정을 통해 행동한다. 이런 행동자 네트워크의 행동을 지형 정보를 알고 있는 비평자 네트워크가 평가하고 개선하는 방식이다.

이같은 학습과정은 1시간 정도 소요되며, 실제 로봇에는 행동자 네트워크만 탑재된다. 주변 지형을 보지 않고 오직 로봇 내부 센서와 측정치만을 활용해 시뮬레이션에서 학습한 환경 중 어느 환경과 유사한지 상상하며 움직인다. 예를 들어 갑자기 계단을 만날 경우, 발이 단차에 닿기 전까지는 알 수 없지만 발이 닿는 순간 빠르게 지형 정보를 추정해 알맞은 제어 명령을 각 모터에 전달하는 것이다. 이를 통해 어떤 환경에서든 순식간에 적응해 걸을 수 있다.

기술이 적용된 드림워커는 지면과 몸체까지 높이의 3분의 2정도 되는 계단을 성공적으로 오르는 모습을 보였다. 연석과 과속방지턱이 많은 대학 캠퍼스나 나무뿌리와 자갈이 많은 야지 등 환경에 무관하게 안정적으로 보행이 가능했다. 연구팀은 드림워커가 화재와 같은 재난으로 인한 비정형 환경 탐사 임무 수행 등에 활용될 수 있을 것이라 기대했다.

이번 연구는 오는 5월말 영국 런던에서 열리는 로보틱스분야 학회 'ICRA (IEEE International Conference on Robotics and Automation)'에서 발표될 예정이다.

Copyright @ NEWSTREE All rights reserved.