국내 연구진이 자율주행차량 단안 카메라에서 촬영한 평면 이미지로 사물의 위치와 크기를 파악할 수 있는 딥러닝 기술을 개발했다.

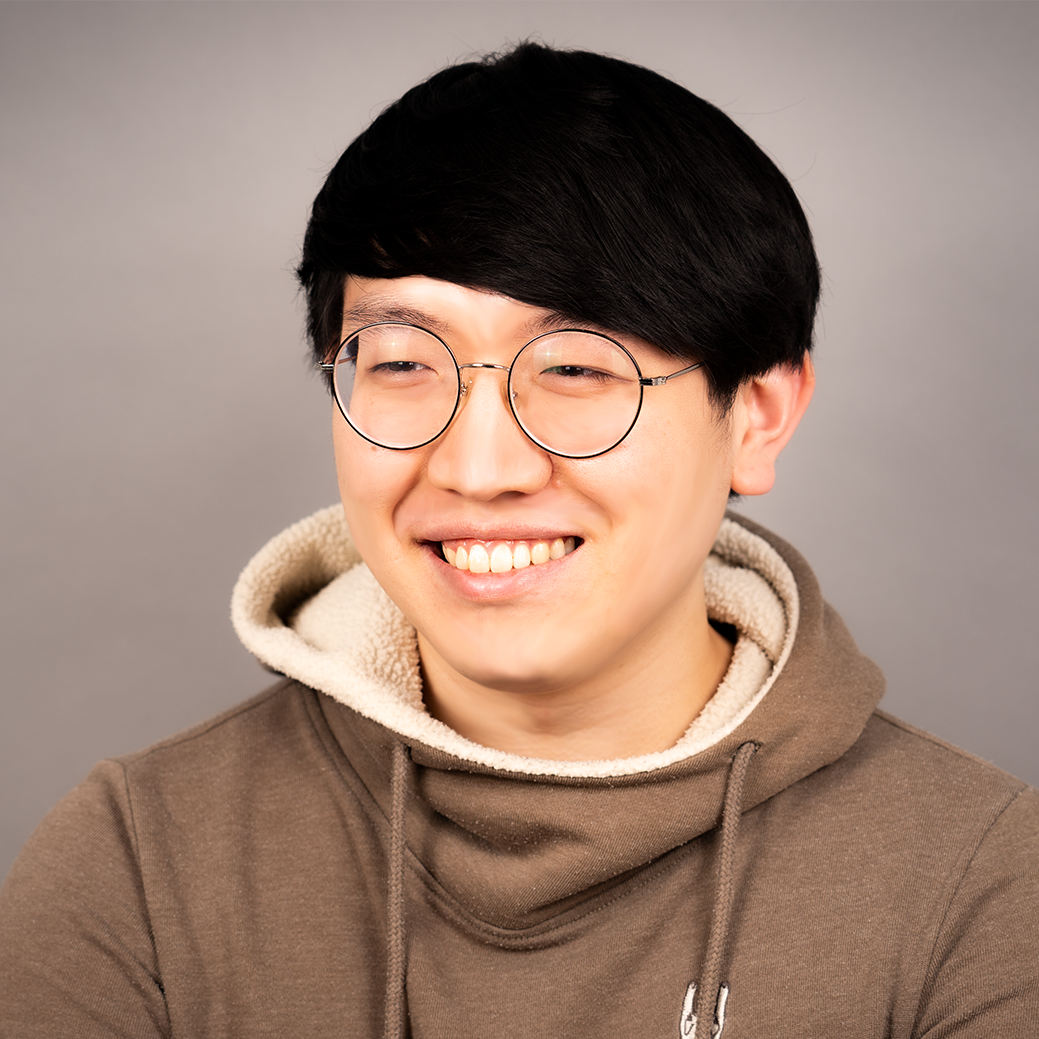

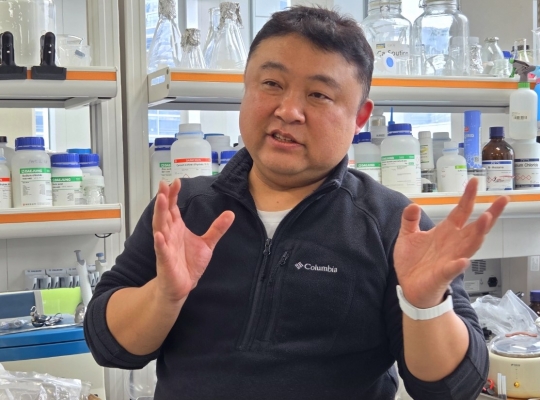

대구경북과학기술원(DGIST) 전기전자컴퓨터공학과 임성훈 교수팀은 단안 카메라로도 3차원(3D) 객체의 위치를 정확하게 추정할 수 있는 딥러닝 기술을 개발했다고 19일 밝혔다.

3D 객체 추정은 자율주행 핵심기술 중 하나로 차량이 주변 환경을 인식하고, 그에 따라 안전하게 움직일 수 있게 하는 중요한 기술이다. 이 기술을 통해 자율주행차는 주변의 사람, 도로 표지판, 다른 차량 등의 위치와 거리 및 크기를 정확하게 파악해 안전한 주행이 가능하게 된다.

자율주행차가 주변을 입체적으로 인식하는 기술로 단안 카메라, 스테레오 카메라를 사용하는 방법과 레이저 신호를 이용한 라이다 센서를 사용하는 방법이 있다. 라이다 센서나 스테레오 카메라는 비싸다는 단점이 있고, 디자인적인 측면에서 개선이 필요하다. 스테레오 카메라는 렌즈가 좌우 2개 설치된 카메라로 입체적인 이미지 촬영이 가능하다.

단안 카메라에도 객체와의 거리를 추정하는 기술이 적용돼 있지만 다른 기술에 비해 정확도가 떨어지는 편이다. 이에 임 교수팀은 이를 개선하기 위해 단안 카메라로 촬영한 평면적인 이미지에서 객체의 깊이 정보를 파악해 차량과의 거리를 기존보다 더 정확하게 파악할 수 있는 기술을 개발했다.

연구팀은 신경망이 객체의 깊이를 잘 구분할 수 있도록 돕는 새로운 매트릭 학습 기법을 제안했다. 이 기법은 각각의 객체의 깊이 정보를 이용해 신경망이 형성하는 특징 공간을 정렬하게 함으로써, 깊이를 쉽게 구분하도록 도와준다. 이 학습 기법은 거의 모든 기존 단안 카메라에 적용이 가능하다.

연구팀 설명에 따르면 이미지 내에서 객체의 위치를 특정하는 과정에서 발생하는 오류를 보정할 수 있는 새로운 방법을 제안해 깊이 추정과 전체적인 3D객체 추정의 성능을 효과적으로 개선할 수 있었다. 또 스테레오 카메라에 비해 렌즈 수가 줄어드는 만큼 비용도 절감된다.

임 교수는 "이번 연구를 통해 개발한 학습기법은 자율주행 시각인지 모델의 연산 시간을 유지하면서 성능을 크게 향상시키는 기술"이라며 "앞으로 이 기술을 더욱 발전시킨다면 자율주행 기술의 발전에 매우 긍정적인 영향을 미칠 것으로 기대된다"고 말했다.

이번 연구결과는 관련분야 학회 'Neural Information Processing Systems 2023'에 게재 승인됐고, 같은 달 개최된 학회에서 포스터 세션으로 발표됐다.

Copyright @ NEWSTREE All rights reserved.